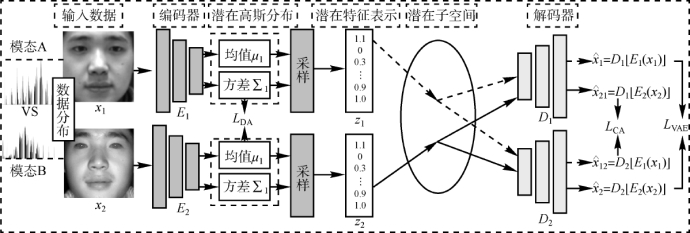

异质人脸生成和识别的难点在于不同模态的人脸数据分布差异很大,并且不同模态的人脸之间的转化是高度非线性变化。因此,异质人脸生成和识别的关键在于建立不同模态人脸间的语义对应关系,并尽可能的获取人脸中的纹理、结构等具有判别能力细节信息。现有的异质人脸生成和识别方法通常是在图像空间或潜在子空间建立不同模态人脸之间的联系,却忽略了图像空间和潜在子空间之间的内在关联性,容易导致不同模态人脸间跨模态关联信息的丢失。本节介绍基于对齐变分自动编码器的异质人脸生成和识别,在提取到单一模态人脸中具有判别能力的身份信息的基础上,在图像空间和潜在子空间同时获取不同模态人脸的跨模态信息。如图2-30所示,是基于对齐变分自动编码器的异质人脸生成和识别的流程框图。CDA-VAE在潜在高斯分布空间和图像空间实现了不同模态人脸特征的对齐,使得同一个人不同模态人脸的特征尽可能地一致。相比单一空间对齐的方法,在图像空间和分布空间同时进行对齐的CDA-VAE方法,能够提取到不同模态人脸间多个空间维度中的不同层次的关联关系,有利于提取到更具判别能力的跨模态关联信息。接下来将详细介绍CDA-VAE的原理和具体实现。

图2-30 基于对齐变分自动编码器的异质人脸生成和识别(CDA-VAE)方法流程框图

基于对齐变分自动编码器的异质人脸生成和识别(CDA-VAE)方法的关键是将两个模型学习得到的特征进行对齐,构建不同模态人脸特征之间相关联的共同的潜在特征空间。变分自动编码器通过编码器将输入数据编码到潜在高斯分布空间,并用解码器将潜在特征表示解码重建原始数据,因此,变分自动编码器通过最小化重建误差损失能够很容易地获得具有判别性的潜在分布空间和重建图像空间。于是,CDA-VAE方法能够在潜在分布空间和重建图像空间协同提取到更丰富的跨模态对齐信息。

为减少信息损失和实现更有效的特征对齐,首先通过重建误差损失函数学习单一模态人脸中具有判别能力的信息。基于交叉重建和分布对齐原则,实现特征在图像空间的精准映射和在特征空间不同模态特征的精确匹配。图2-30描述了通过跨模态对齐损失函数(LDA)和分布对齐损失函数(LDA)实现特征对齐的工作。在特征对齐的基础上,不仅可以直接从潜在特征表示空间提取到模态不变的特征,而且可以由解码器解码潜在特征得到相应模态的生成人脸。因此,CDA-VAE通过融合变分自动编码重建误差损失函数、跨模态对齐损失函数和分布对齐损失函数来实现跨模态人脸生成和识别。

1.重建误差损失函数

现有的异质人脸数据集通常包含两种模态。因此,模型中包含两个编码器,分别负责人脸的一种模态。为了尽可能地减少特征学习过程中的信息损失,利用重建误差损失函数,将编码器的输出输入到解码器中重建输入人脸图像,并通过最小化变分自动编码重建误差损失,学习到具有判别能力的模态内特征。

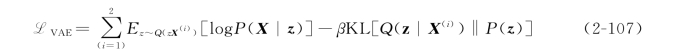

针对两个模态的人脸数据设置两个变分自动编码器,则CDA-VAE的重建误差损失函数是两个变分自动编码器损失的总和,写作:

式中,X(i)表示输入数据属于模态i,z为潜在向量(潜在特征表示),β系数决定KL散度项的权重。

2.跨模态对齐损失函数

跨模态对齐是通过解码重构来自同一个体的另一模态的特征来实现的。也就是说,模态A的特征编码输入到模态B的解码器中来重构模态B的人脸图像,而模态B的特征编码输入模态A的解码器中来重构模态A的人脸图像。因此,每一个模态的解码器除了用于训练对应模态的潜在特征,也将用于训练另一模态的潜在特征。跨模态对齐损失函数通过交叉重建损失来定义:

式中,E(i)表示第i个模态的样本通过编码器得到编码特征,D(j)表示特征通过解码器得到第j个模态的重建样本。通过跨模态对齐损失函数对模型进行优化,能够在图像空间中学习到不同模态之间的关联信息,并映射到潜在特征表示空间,从而实现将不同模态人脸图像的特征映射到同一特征空间。

3.分布对齐损失函数

分布对齐通过直接在潜在特征空间最小化同一个体不同模态的潜在高斯分布的Wasserstein距离来实现。因此,两个模态人脸数据的高斯分布之间的2-Wasserstein距离,可构成封闭解:

式中,F表示Frobenius范数。因此,在CDA-VAE模型中,分布对齐损失函数写作:

![]()

通过分布对齐损失函数对齐不同模态人脸的潜在特征分布,可实现不同模态的特征在共同潜在特征空间的精准对齐。(https://www.xing528.com)

4.CDA-VAE损失函数

特征对齐方法的整体损失函数由重建误差损失函数、跨模态对齐损失函数、分布对齐损失函数三部分构成。重建误差损失函数能够减少信息损失,学习模态内具有判别能力的身份信息。跨模态对齐损失函数和分布对齐损失函数能够有效地关联不同模态人脸的图像空间和潜在分布空间,学习跨模态信息。为同时学习具有判别能力的身份信息和跨模态信息,CDA-VAE算法将三种损失函数有机结合,学习不同模态人脸的共同潜在特征空间和特征表示。

![]()

式中,γ和δ系数表示交叉对齐损失和分布对齐损失的权重。γ和δ系数在训练的不同阶段将被设置不同的权重值,有利于逐步实现特征对齐。

5.对齐变分自动编码器的具体实现

在基于对齐变分自动编码的异质人脸生成方法中,选用基于卷积神经网络的变分自动编码器模型学习含有高层语义信息的特征。图2-31是基于卷积神经网络的变分自动编码器模型的结构框图。

图2-31 基于卷积神经网络的变分自动编码器模型的结构框图

(1)编码器由4个卷积层组成,卷积核为4×4,通过将步长设置为2实现下采样。在每个卷积层后都添加批量归一化(Batch Normalization,BN)来优化网络结构,并使用带泄露修正线性单元(Leaky Re LU)函数作为激活函数。

(2)在编码器中加入两个全连接的输出层,分别用于计算均值和方差,均值和方差将用于计算潜在向量和KL散度。

(3)解码器的卷积核设置为3×3,步长设置为1,通过最近邻法上采样。

在基于卷积神经网络的变分自动编码器中,编码器和解码器的结构大致对称:编码器实现学习到能够表示输入样本的潜在向量;解码器由潜在向量逐步上采样,实现从低分辨率重构样本中重建出高分辨率的重构样本。

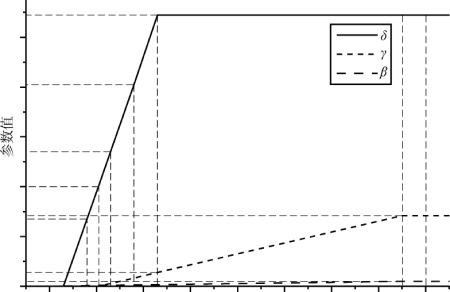

在模型的训练阶段,首先训练变分自动编码器学习特定模态的人脸中具有判别能力的信息。在变分自动编码器学会对特定模态进行编码之后,通过跨模态对齐损失函数和分布对齐损失函数约束模型将不同模态的特征映射到共同的编码空间和实现精确的特征对齐。采用warm up策略更新损失函数公式(2-112)中的权重系数:δ从第6个epoch开始到第44个epoch为止,以0.27为步长递增;γ从第21个epoch开始到第150个epoch为止,以0.022为步长递增;对于KL散度损失的β系数,从第0个epoch开始到第180个epoch为止,以0.0013为步长递增。另外,为增强潜在向量的判别能力,在编码器学习得到潜在向量后,增加softmax层。softmax损失函数从第50个epoch开始起作用。

图2-32 loss函数中基于warm up策略更新的参数权重

在测试阶段,同样通过可视化人脸生成的效果和人脸识别的准确率对异质人脸生成效果和对齐潜在特征的跨模态识别能力进行验证。

(1)在人脸生成实验中,模态A的人脸输入模态A的编码器得到模态A的人脸特征,将该特征输入到模态A的解码器中,则能够重建出模态A的人脸,而输入到模态B的解码器,将重建出模态B的人脸。

(2)在人脸识别实验中,模态A的人脸图像和模态B的人脸图像分别输入到模态A的编码器和模态B的编码器中,模态A的编码器和模态B的编码器将两种模态映射到共享的潜在特征空间,两者的潜在特征将作为最终输出的人脸特征,直接用于人脸识别中。

免责声明:以上内容源自网络,版权归原作者所有,如有侵犯您的原创版权请告知,我们将尽快删除相关内容。