属性选择(也称特征选择或者特征子集选择)是模式识别和人工智能领域内非常经典的问题,其目标就是通过采用某种选定的规则或评价指标获取最优或者局部最优的特征子集,采用数学符号可以对其进行如下定义[75]:

给定数据集U 及其属性集合X,给出机器学习算法L,其中属性集合中包含n 个子属性,分别用表示X1,X2,…,Xn,存在属性标记Y,以及符合某分布D 的样本空间,则可计算得出最优特征子集Xbest 使得某一选定评价规则J =J ( L, U)达到最优或者局部最优。

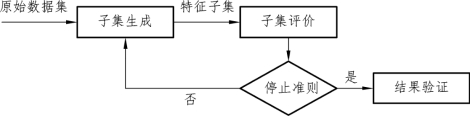

根据属性选择的定义及目标,Dash 等人提出了属性选择的基本框架,其框架组成如图5-2 所示[76]。

图5-2 属性选择的基本框架

由图5-2 可知,属性选择方法主要包括四个部分:候选属性子集的生成、属性评价规则、停止准则和结果验证方法。而目前研究主要集中于候选属性子集的生成(即搜索策略)及评价规则两方面。常用的搜索策略包括穷举式搜索[77]、不确定性搜索[78]、启发式搜索[79]等,这几种搜索方法的优缺点较为明显,不同搜索方法适用的数据集也很明确。当原始数据集中包含特征数较少时,采用穷举式搜索较为合理;如果希望计算速度快,则采用启发式策略更为恰当;若希望获取高性能的属性子集,且对时间成本要求不高,则可采用不确定性搜索策略。在评价准则方面,研究者们根据是否独立于后续的学习算法将属性选择方法分为封装式(Wrapper)[80]和过滤式(Filter)[81]。其中,Wrapper 方法在进行属性选择时需结合具体机器学习方法的特点,通过采用选取的归纳算法结合重复统计抽样技术(如十折交叉验证),实现对特征子集准确性的评价。其优点是准确性高,但是属性选择速度慢,容易丧失数据的一般特性。Filter 方法则可独立于机器学习方法对数据进行分析处理,一般直接利用数据的统计性能对属性进行评估。其优点是速度快,能够直接得出最优或者局部最优属性子集。

人机共驾智能车系统驾驶模式决策属性选择的研究重点是希望能够通过采用属性选择方法获取高性能的最优特征集。基于此,本研究分别从搜索策略评估准则的特点着手,尝试得出最优的决策属性选择算法。

5.1.2.1 搜索策略

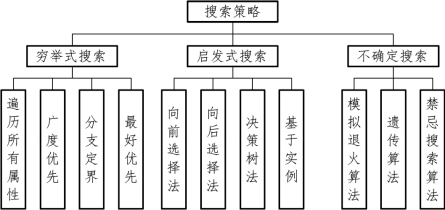

属性选择中的搜索策略主要包括穷举式搜索、启发式搜索和不确定搜索(即随机搜索),这些搜索策略的特点如下:

(1)穷举式搜索(Exhaustion)。

穷举式搜索也称完全搜索,是一种通过遍历属性空间中所有属性的组合,进而得出最优属性组合的搜索方法。当属性数量为N 时,其计算复杂度为O(2N)。

该方法的优点是经计算后一定能够得到最优的属性子集。但是其缺点同样明显,由于计算需遍历所有属性组合,当属性空间过大时,其计算复杂度较大和耗费时间太长,导致其在实际应用中可用性不强。

(2)启发式搜索(Heuristic)。

启发式搜索主要是利用期望的人工机器调度规则,通过重复迭代的方式产生递增的属性子集。当属性数量为时,其计算复杂度一般小于或等于O(2N)。该算法的优点是简单快捷,但由于该算法是以牺牲全局最优为代价,所以无法保证搜索结果为最优。

(3)不确定搜索(Random)。

不确定搜索也称随机搜索,即随机生成属性子集。其属性子集生成方法包括概率随机方法和完全随机方法两种。无论是概率随机方法还是完全随机方法,其计算复杂度一般远远小于O(2N)。该算法的优点是搜索时间短,实用性较高。缺点是在搜索过程中,需要人为进行一些参数的设定,这导致其搜索结果存在较大的不确定性。

近年来,随着数据挖掘技术的飞速发展,属性选择策略方面的研究也得到了长足的发展,现有的搜索算法及其分类如图5-3 所示。

图5-3 现有搜索算法

5.1.2.2 评价准则研究现状

Filter 属性选择方法通常采用评价准则来增强属性与分类目标间的相关性,同时削弱属性之间的关联性。目前常用的评价准则函数包括4 类:距离测度、信息测度、相关性测度以及一致性测度。(https://www.xing528.com)

(1)距离测度。

距离测度是一种根据样本之间相似度来进行属性选择的方法,属性间的距离越小表示越相似,距离越大则表示属性间可分性越大。距离测度包括欧式距离、切比雪夫距离、马氏距离、平方距离和标准化欧式距离等,其中欧式距离应用最为广泛,其定义为:对于任意特征,它与其他特征间的欧式距离为它们间的方差,其计算式:

(2)信息测度。

信息测度是以后验概率分布的集中程度为度量的一种评价方法,考虑到采用具有最小不确定性属性对分类效果最为有利,一般采用信息熵作为其评价测度。假设存在属性集合Y={ y1 , y2, …, ym},其中 y i被选中的概率为 Pi,那么属性集的信息熵的计算公式:

式中, H (Y ) 值越小,表示Y 中的属性分布越集中,反之则越分散。

(3)相关性测度。

相关性测度是一种利用属性间、属性与分类目标之间相关度来进行属性评估的方法,最优属性集或者局部最优属性集中属性间一般为不相关,而属性与分类目标为高度相关。最常用的相关性评价方法为Pearson 相关系数法,其定义描述为:存在任意两个变量X 和Y,这两个变量间的皮尔逊相关系数可通过(4-3)进行计算:

式中,E 表示数学期望。

(4)一致性测度。

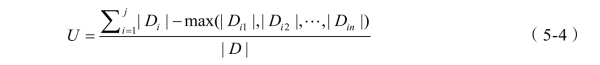

假设x 和y 为数据集D 中的两个样本,如果它们的特征值都相同,但所归属的类别却不一样,则可认为它们之间的关系是不一致的。一致性测度一般用不一致率进行度量。为得到数据集D 的不一致率,可先进行如下定义:将数据集D 分割成FD={ D1 , D2, …, Dj}(j 为属性集合中所有可能的取值),其中Di 对于任意 x ,y ∈Di 存在x 和y 条件属性的取值均一致;对FD 中任意Di和Dk (i ≠ k),不存在x∈Di 和y ∈Dk ,使得x 和y 条件属性的取值相同。在对FD 中的每一个变量Di 做类似的分割,则Di 被分割成FDi ={D i 1, Di2, …,D in}(n 为决策属性中所有可能的取值);其中Di i表示对任意 xi ,yi ∈Di i,x 和y 决策属性的取值相同;对FDi 中任意Di i和Di k(i ≠ k),不存在x∈Di 和y ∈Dk ,使得x 和y 决策属性的取值相同。数据集D 的不一致率U 为:

该方法受训练数据集的影响较大,且在评价过程中需要设定一些参数。

(5)分类错误率。

Wrapper 属性选择方法采用的评价标准为分类器的错误率,其特点是将属性选择算法作为机器学习算法的一部分,以分类性能为属性重要度排序的评价标准,其目标就是期望取得较高的分类性能。由于该方法对样本量及属性维度较小的数据集的效果较为理想,目前在交通领域内也出现了较多的相关研究。Chang 等人提出采用分类回归树(CART)模型对交通事故严重程度的影响因素进行了分析[82]。De Oña 等人采用贝叶斯网络方法对山区高速公路的事故严重程度的诱因进行了分析,并基于该方法提取了其主要影响特征[83]。Michalaki 等人采用Logistic 回归方法构建高速公路交通事故严重性预测模型,并基于分析结果得出影响事故发生的属性集[84]。另外典型的分类模型还包括朴素贝叶斯(NB)、决策树(C4.5)、支持向量机(SVM)等[85]。

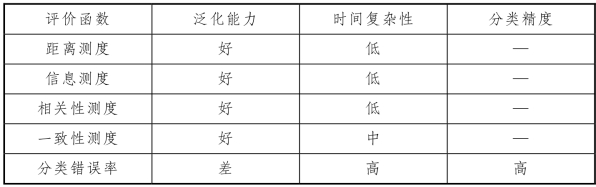

根据不同评价函数的定义和计算方法,分别对其在泛化能力、时间复杂性和分类精度等性能指标方面的优缺点进行总结,如表5-1 所示[86]。

表5-1 评价函数性能指标

免责声明:以上内容源自网络,版权归原作者所有,如有侵犯您的原创版权请告知,我们将尽快删除相关内容。