卷积神经网络是一种包含卷积计算且具有深度结构的前馈神经网络。卷积的提出受到了生物学上感受野机制的启发,根据卷积的定义,卷积神经网络有两个重要特性:局部连接和权重共享。局部连接指的是在卷积层中每一个神经元,都和下一层中某个局部窗口内的神经元相连,构成一个局部连接网络;权重共享是指作为参数的卷积核对于某一层的所有神经元都是相同的,即一个卷积核只获取输入数据中一种特定的局部特征,要提取多种特征需要使用多个不同的卷积核。由于局部链接和权重共享,卷积层的参数只有一个K维的权重ω(l)和1维的偏置b(l),共K+1个参数,参数个数与神经元数量无关。卷积神经网络的特性使得卷积神经网络满足一定程度的平移、尺度和旋转不变性,隐藏层内的卷积核参数共享和层间连接的稀疏性,使得卷积神经网络能够以较小的参数来进行特征处理。

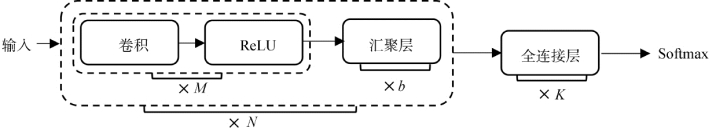

一个典型的卷积神经网络主要由输入层、卷积层、池化层、激活层和全连接层组成,如图4-10所示。其中,卷积、池化和激活函数的目的是特征提取,全连接层则起到分类识别的作用。

图4-10 典型的卷积神经网络整体结构

一、输入层

输入层是整个神经网络的输入,在处理图像的卷积神经网络中,表示图像像素矩阵。

二、卷积层(https://www.xing528.com)

卷积层的作用是提取一个局部区域的特征,即将神经网络中的每一个小块进行更加深入的分析,从而得到抽象程度更高的特征。不同的卷积核相当于不同的特征提取器。一幅图像经过卷积提取到的特征称为特征映射(feature map),或特征图。每一层使用多个不同的特征图,可以更好地表示图像的特征。

三、池化层

池化层也叫做子采样层,作用是进行特征选择、降低特征数量,从而减少参数数量。卷积层虽然可以显著减少网络中连接的数量,但是特征图中神经元的个数并没有显著降低,如果直接连接分类器,分类器的输入维数仍然很高,容易出现过采样。通过池化层,可以缩小最后全连接层中神经元的个数,从而达到减少整个神经网络中的参数的目的。常用的池化方法包括最大池化(maximum pooling)和平均池化(mean pooling),分别选择一个区域内所有神经元的最大激活值和平均激活值作为该区域的表示。需要说明的是,随着卷积的操作性越来越灵活,池化层的作用变得越来越小,在网络中的比例逐渐降低,趋向于全卷积网络。

四、激活层

激活层把卷积、池化层的输出结果做非线性映射。卷积神经网络采用的激活函数一般为ReLU,它的特点是收敛快,求取梯度较为简单。

五、全连接层

如果说卷积层、池化层和激活函数层等操作是将原始数据映射到隐藏层特征空间的话,那么全连接层则起到将学到的特征映射到样本标记空间的作用。全连接层是卷积神经网络的最后几层(一般是三层,其中最后一层输出图像分类的类别分数),全连接层的神经元与前一层也是全连接的。全连接层不具备卷积层的局部连接和权重共享的特点,但二者神经元的计算方式相同,全连接层和卷积层可以相互转化。

免责声明:以上内容源自网络,版权归原作者所有,如有侵犯您的原创版权请告知,我们将尽快删除相关内容。