自编码器是一种无监督特征学习网络,目的是利用反向传播算法,以无监督的方式学习一组数据的有效编码(如有效的低维特征表达)。假设有一组D维样本x(n)∈RD,1≤n≤N,自编码器将这组数据映射到特征空间得到每个样本的编码z(n)∈RM,1≤n≤N,并且希望这组编码可以重构出原来的样本。自编码器的结构可以分为编码器和解码器两部分,自编码器的学习目标是利用反向传播算法,尝试学习一个恒等函数使重构误差最小化。

一、简单自编码器网络

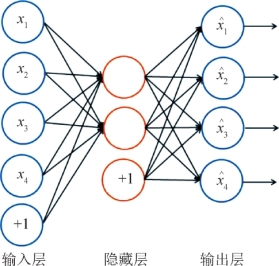

图4-5给出了一个最简单的两层结构自编码器,包括1个输入层、1个隐含层和1个输出层,输入层到隐藏层用来编码,隐藏层到输出层用来解码,层与层之间互相全连接。从图中可以看出,自编码器的结构与一般的神经网络相同,区别在于自编码网络的输入层和输出层神经元数目是一致的。

图4-5 两层网络结构的自编码器网络

二、稀疏自编码器网络

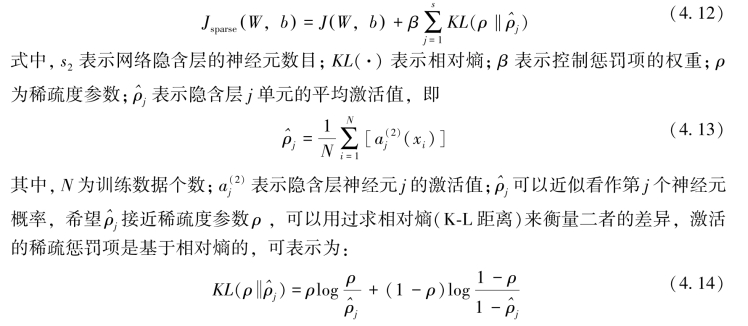

自编码器既可以学习低维编码,也能够学习高维稀疏编码。一般情况下,隐藏层z的维度M小于输入样本x的维度D,此时自编码器经过编码学习输入数据的低维表示,然后经过解码重构出输入数据。假设隐藏层z维度M大于输入样本x的维度D,可以通过对隐藏层神经元施加限制条件来学习输入数据更有意义的表示。例如,可以对隐藏层神经元加入稀疏性限制,从而得到一种常用的自编码网络,即稀疏自编码器(sparse auto-encoder,SAE)。稀疏自编码器的优点是进行了隐式的特征选择。(https://www.xing528.com)

稀疏自编码网络在目标函数中加入稀疏惩罚项,增加对自编码网络的稀疏性限制,稀疏惩罚项的计算如下式所示:

三、堆叠自编码器网络

图4-5所示的自编码网络只包含了一个隐含层,属于“浅层”的网络。很多时候,仅使用两层神经网络的自编码器不足以学习更好的图像特征表示,为此,可以通过增加隐藏层数目加深网络,以获取更加抽象的数据表示。这种通过逐层堆叠训练的深层自编码器也称为堆叠自编码器(stacked auto-encoder,SAE)。

四、降噪自编码器网络

自编码器的目的是得到有效的数据表示,而有效数据表示除了具有最小重构误差或满足稀疏性等性质之外,还可以具备其它性质,比如对数据部分毁坏的鲁棒性。降噪自编码器(denoising auto-encoder,DAE)是一种通过引入噪声增加编码鲁棒性的自编码器,通过引入噪声学习更鲁棒的数据编码,并提高模型的泛化能力。

免责声明:以上内容源自网络,版权归原作者所有,如有侵犯您的原创版权请告知,我们将尽快删除相关内容。