如前所述,深度学习指的是一类广泛的机器学习技术和架构,其特点是采用多层的非线性信息处理方法,这种方法在本质上是分层的。根据这些结构和技术不同的应用领域,如合成/生成或识别/分类,我们可以大致把这些结构分为三类:

(1)无监督或生成式学习的深度网络 针对模式分析和合成任务,用于在没有目标类标签信息的情况下捕捉观测到的或可见数据的高阶相关性。各种文献中的无监督特征或表达学习指的就是这一类深度网络。当用于生成模式时,它也可以用来描述可见数据和其相关分类的联合概率分布,此时它具有可利用的类别标签,而且这些类别标签被看作是可见数据的一部分。在后一种情况中,利用贝叶斯准则可以把生成式学习网络转换为判别式学习网络。

(2)有监督学习的深度网络 直接提供用于模式分类目的的判别能力,它的特点是描述了可见数据条件下的类别后验分布。对于这种有监督的学习,目标类别标签总是以直接或间接形式给出,所以它们也被称作判别式深度网络。

(3)混合深度网络 目标是判别式模型,往往以生成式或无监督深度网络的结果作为重要辅助,可以通过更好地优化和正则化类别(2)中的深度网络来实现,也可以通过在对类别(1)中所述的深度生成式或无监督深度网络的参数进行估计时,使用判别式准则来实现。

注意上述(3)中的“混合”一词和有些文献中的用法会有不同。在这些文献中“混合”指的是混合系统,即把神经网络的输出概率送入到HMM的语音识别系统中[17,25,42,261]。(https://www.xing528.com)

按照通常采用的机器学习惯例(例如,文献[264]中第28章和文献[95]),自然地把深度学习技术分为深度判别式模型(例如,深度神经网络DNN、递归神经网络RNN、卷积神经网络CNN等)和生成式/无监督模型(例如,受限玻尔兹曼机RBM、深度置信网络DBN、深度玻尔兹曼机DBM、正则化的自编码器等),然而这种二元分类方法忽略了通过深度学习研究所获得的重要观点,即生成式和无监督学习模型如何通过更好地进行正则化与优化,来大幅提高DNN和其他深度判别式和监督学习模型的训练效果。同时,无监督学习的深度网络并不一定必须是概率模型,也不一定能从模型(例如,传统的自编码器、稀疏编码网络等)中得到有意义的采样。我们注意到最近的研究对传统的除噪自编码器进行了扩展,使得它们可以高效地采样,从而成为生成式模型[5,24,30]。然而,传统的二元分类的确指出了无监督和有监督学习深度神经网络的一些关键差异。对这两类模型进行比较可以发现,深度有监督的学习模型(如DNN)的训练和测试通常更高效,构建更灵活,也更适合于复杂系统的端到端学习(例如,非近似推断(no approximate inference)和环路信念传播(loopy belief propagation))。另一方面,深度无监督学习模型,尤其是概率生成模型,更容易理解,更容易嵌入领域知识,更容易组合,更容易对不确定性进行处理,但对于复杂系统,它们通常在推断和学习上很难处理。我们提出的三元分类也仍然包含以上区别,因此三元分类贯穿全书。

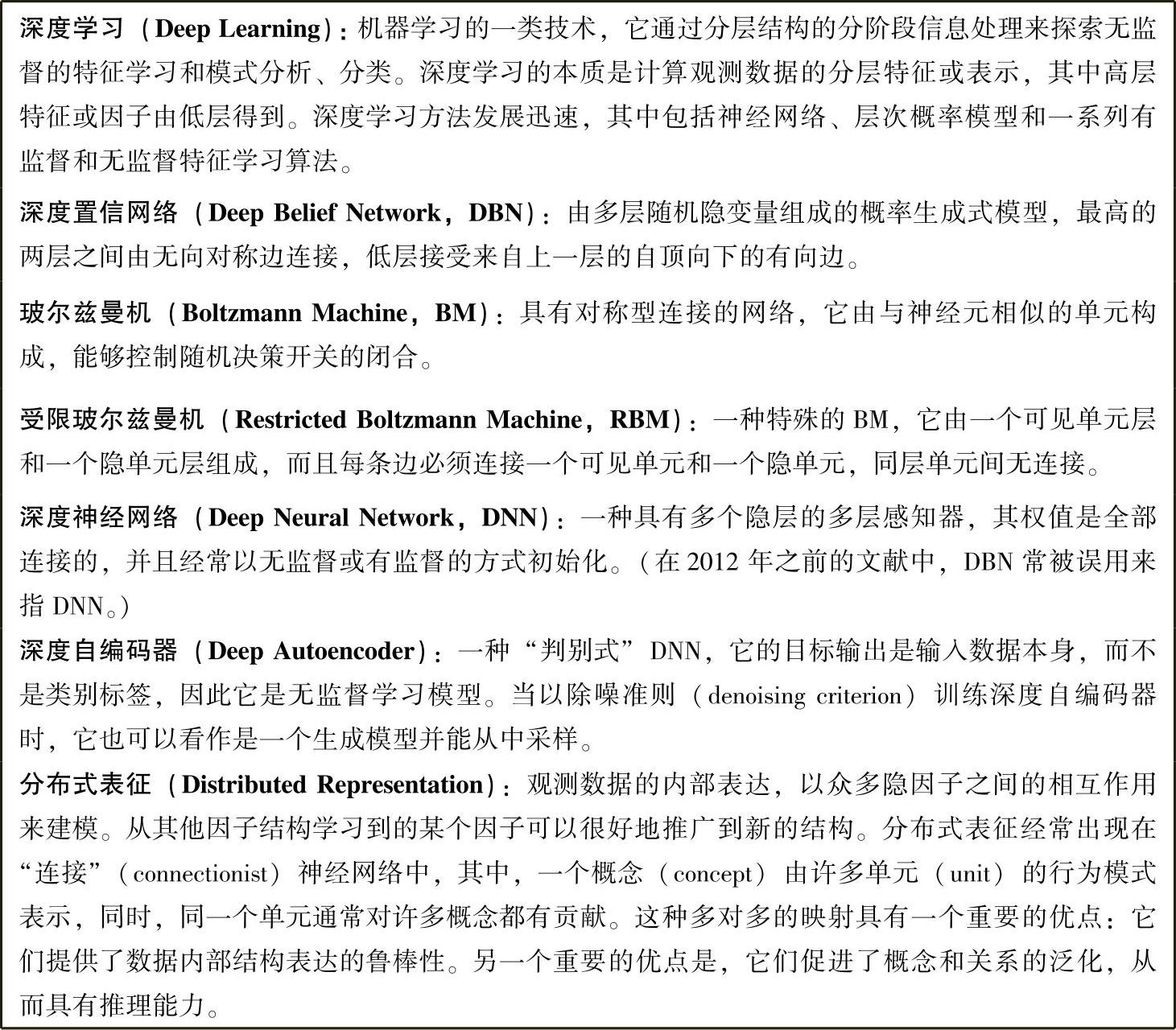

下面我们回顾上述三个类别中具有代表性的工作,表3.1中总结了几个基本的定义,这些深度结构的应用将在第7~11章进行介绍,包括有监督、无监督和混合学习。

表3.1 深度学习基本术语

免责声明:以上内容源自网络,版权归原作者所有,如有侵犯您的原创版权请告知,我们将尽快删除相关内容。