在Mesos模式下运行Spark集群,首先需要部署Mesos到所有的工作结点上,在Mesos的官网上分别有在Ubuntu和CentOS上的安装使用,参考网址:http://mesos.apache.org/ gettingstarted/。这里我们演示在CentOS上的Mesos部署。

1.操作系统

2.修改结点名字

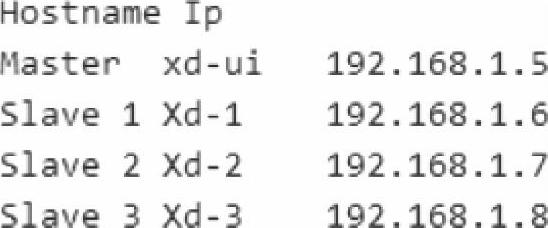

(1)本次搭建Spark集群机器主从结点,修改host(/etc/hosts)如下:

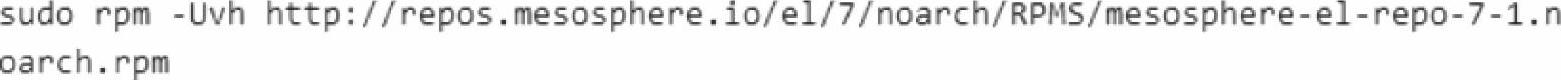

(2)安装Mesosphere repo。

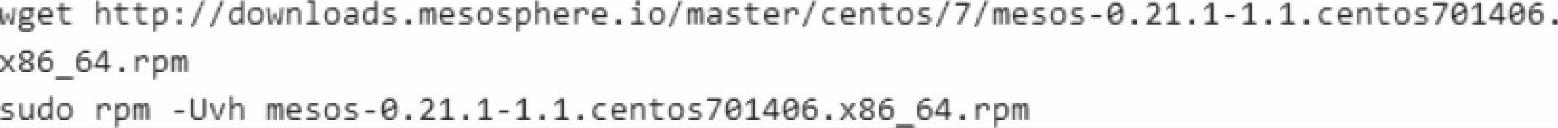

(3)下载Apache Mesos。

(4)安装Marathon。

(5)安装Chronos。

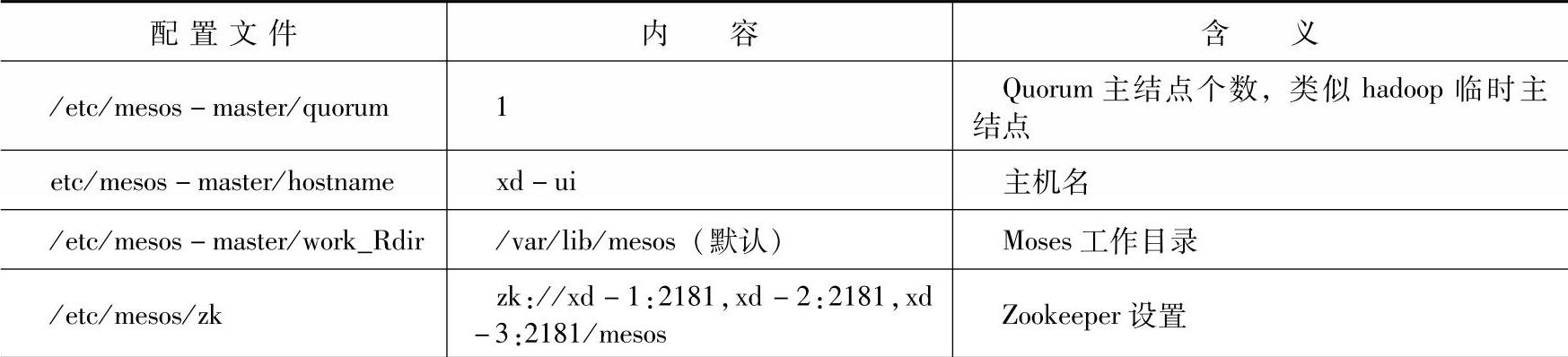

(6)配置Mesos master结点,节点配置属性如表4-5所示。

表4-5 Mesos master结点配置属性

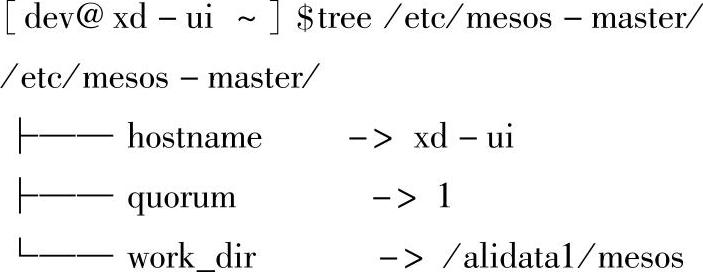

配置结构显示如下。

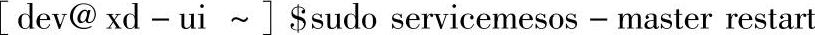

(7)重启Mesos Master。

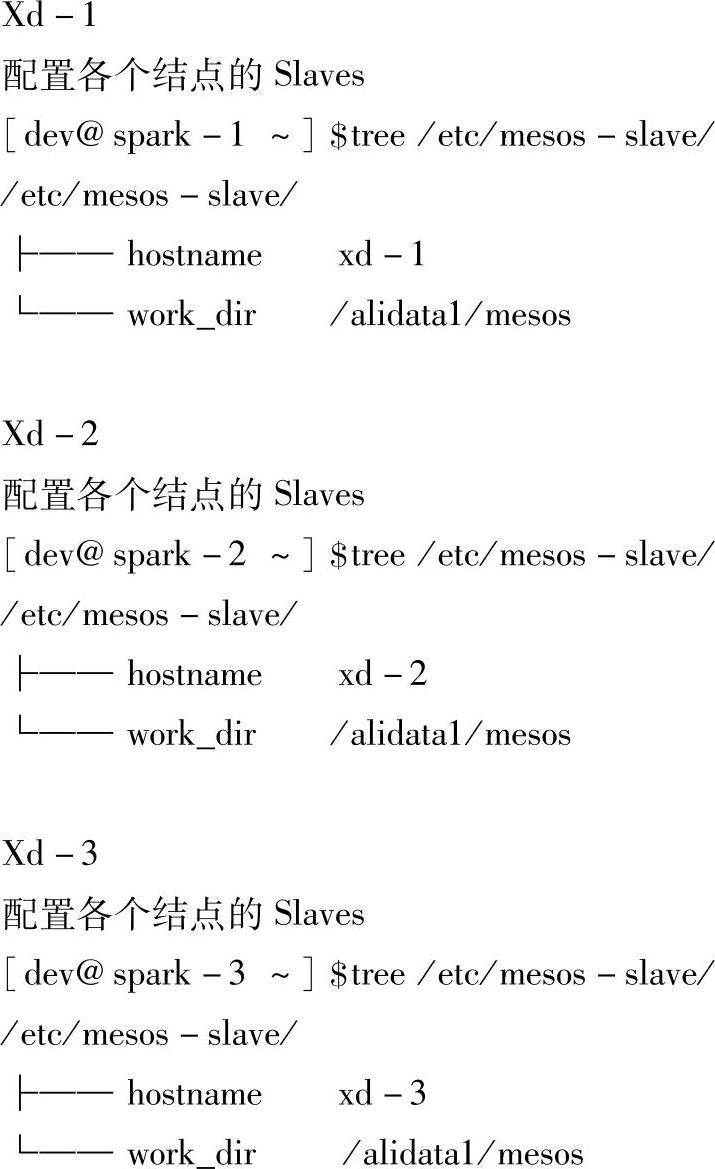

(8)配置Mesosphere slave结点。

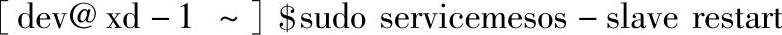

(9)在结点[xd-1,xd-2,xd-3]上重启各个Mesos Slaves。

(https://www.xing528.com)

(https://www.xing528.com)

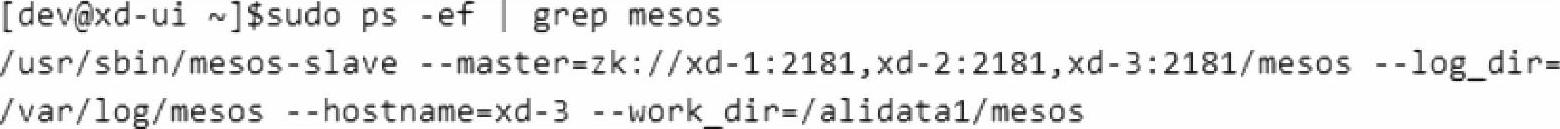

(10)检查各个结点是否起来。出现以下类似内容则启动正常。

(11)访问Mesosphere主页,确认各个结点是否正常。浏览器输入http://xd-ui 5050/,点击slaves标签页查看。

3.Spark配置

(1)下载并解压spark-1.2.1-bin-hadoop2.4.tgz。

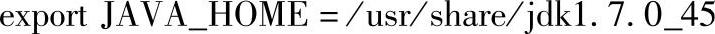

(2)修改${SPARK_RHOME}/bin/spark-class或者conf/spark-env.sh,在首行添加:

注意:确定所有的Mesos结点的JDK,按照目录是一致的。

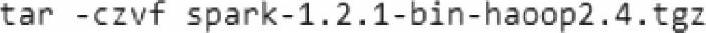

(3)再压缩成spark-1.2.1-bin-hadoop2.4.tgz。

(4)再发布压缩tgz包到hdfs或者http。

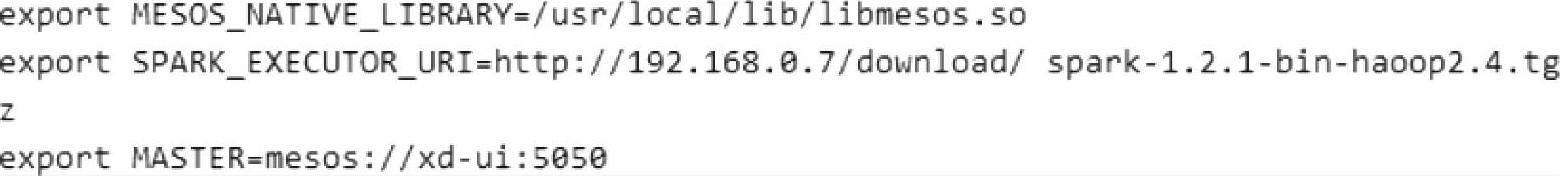

(5)把解压的spark目录放到mesos-master上。并且配置${SPARK_RHOME}/conf/ spark-env.sh,在文件末尾添加:

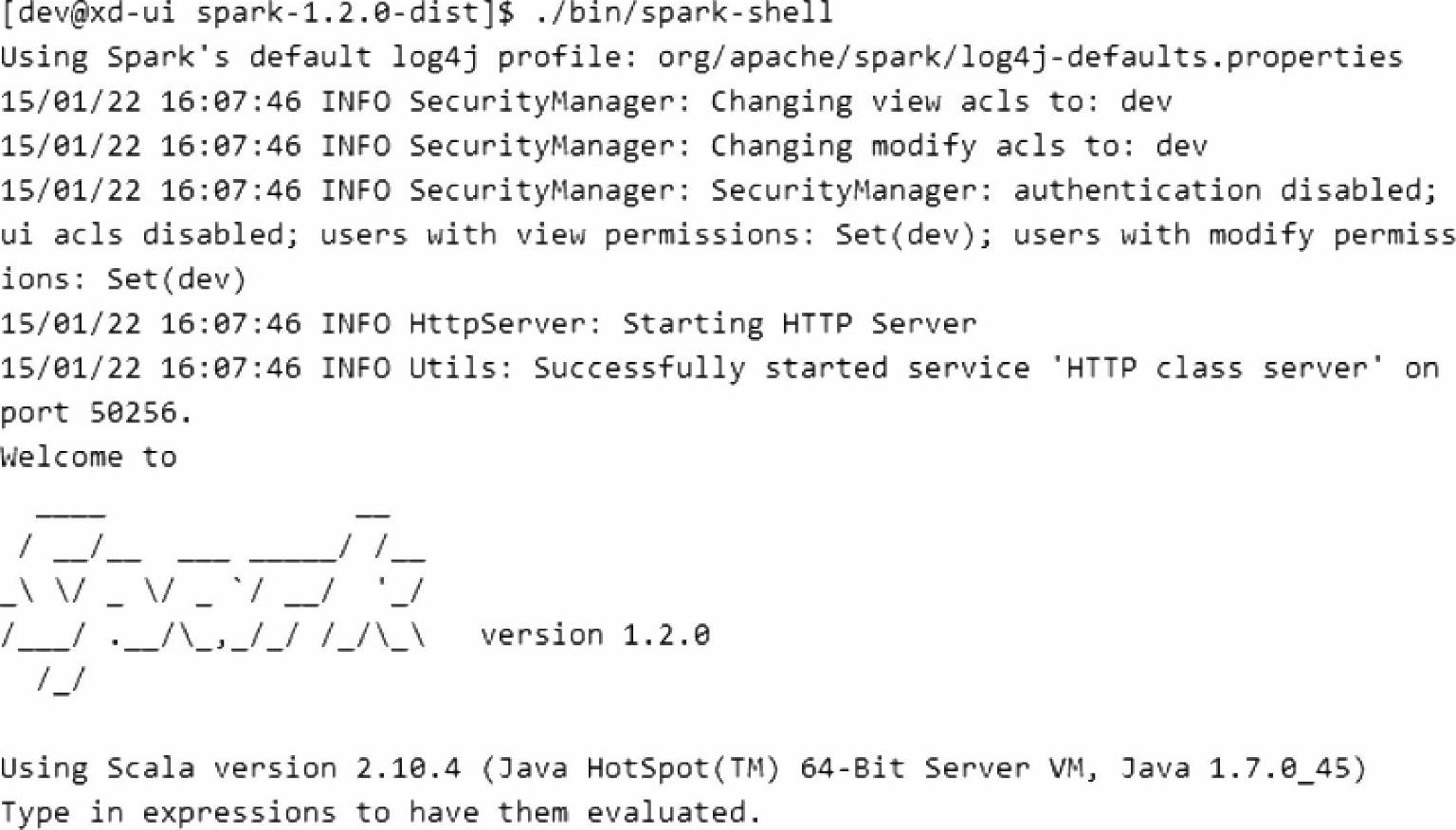

(6)启动Spark shell。

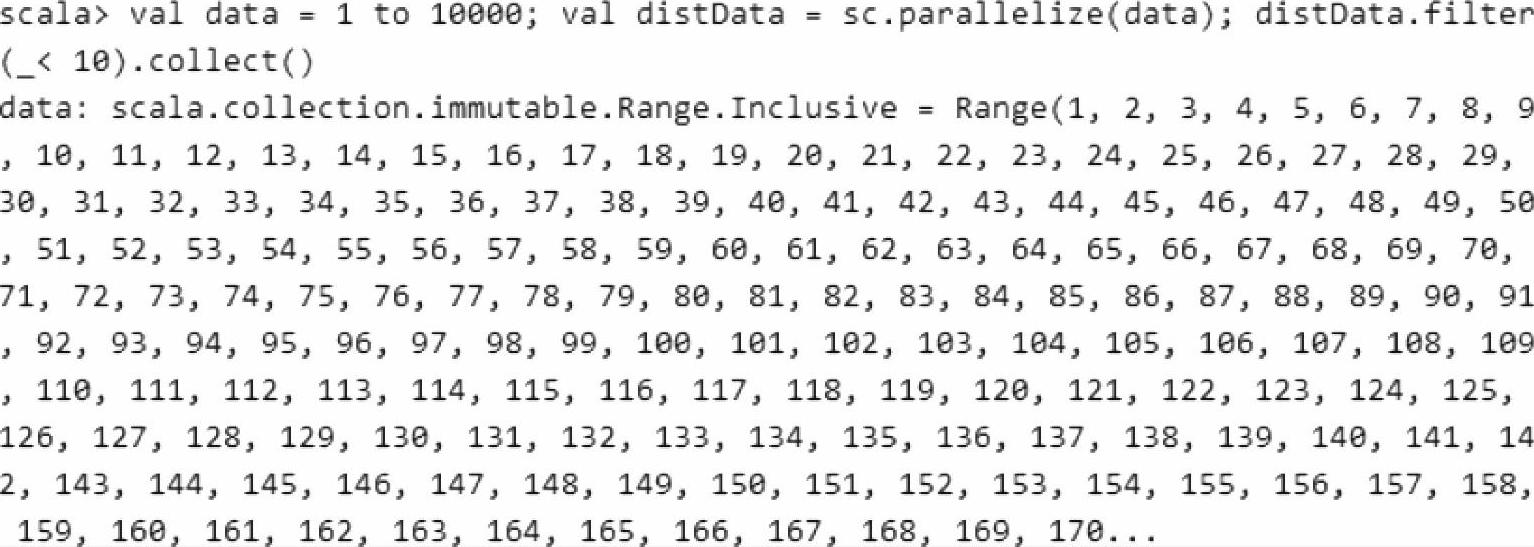

(7)输入测试代码。

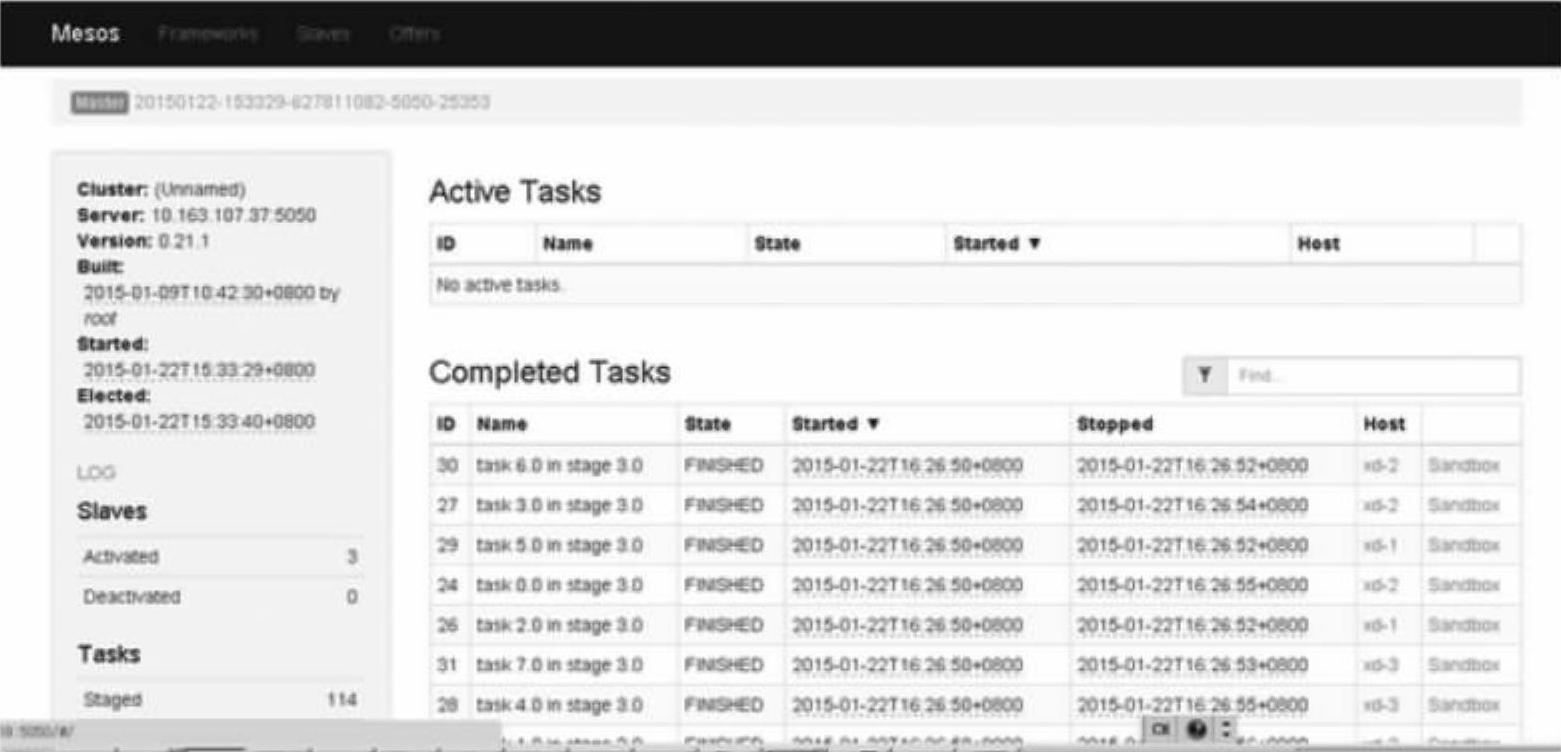

(8)查看mesos UI界面确定任务是否运行成功。浏览器输入http://xd-ui:5050(如图4-13所示)。

图4-13 Mosos的WebUI

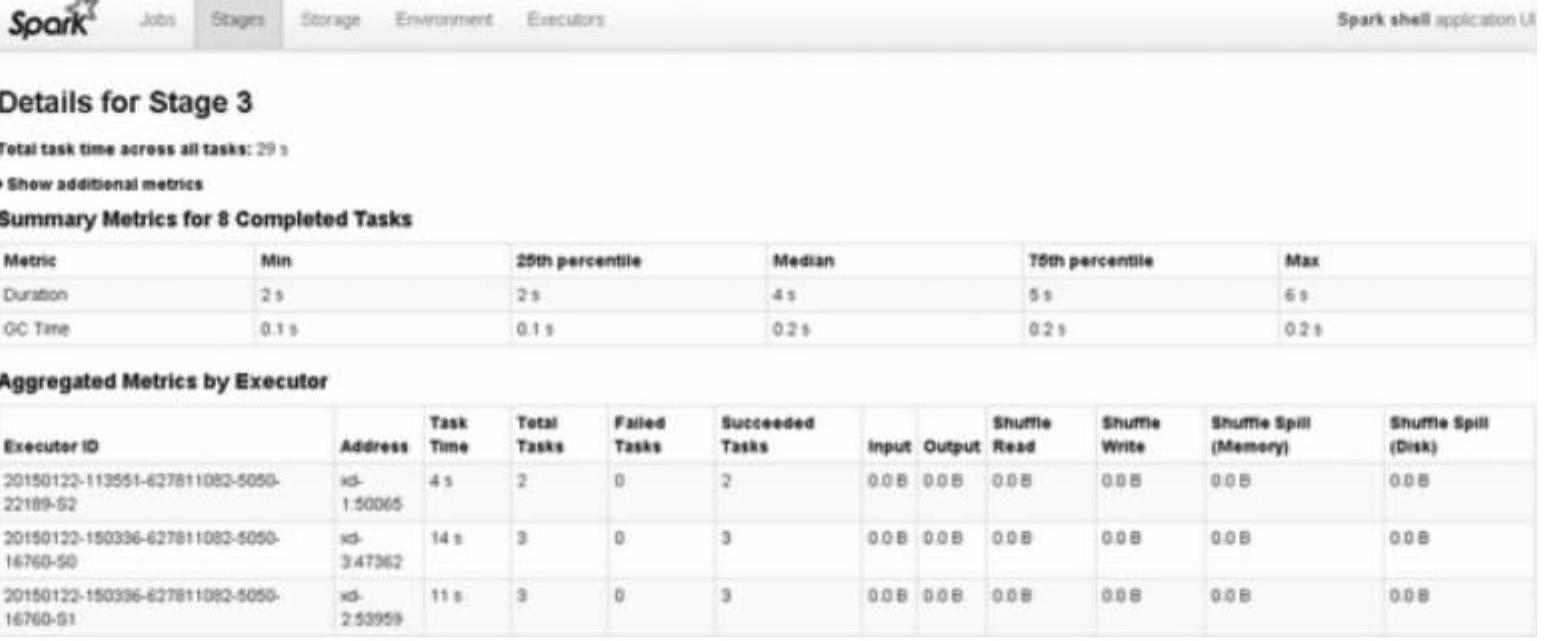

(9)打开spark WebUI界面查看任务执行结果:浏览器输入:http://xd-ui:4040(如图4-14所示)。

图4-14 任务执行结果

免责声明:以上内容源自网络,版权归原作者所有,如有侵犯您的原创版权请告知,我们将尽快删除相关内容。